ChatGPT绝对是近期媒体报道热点中的热点。生命未来研究所(Future of Life Institute)日前在他们的网站上贴出了一封“公开信”,一石激起千层浪。

(资料图片仅供参考)

(资料图片仅供参考)

“公开信”呼吁“所有人工智能实验室至少暂停6个月比ChatGPT-4更强大的人工智能系统的训练”,说法这么具体,体现了人类对于ChatGPT发展速度带来的挑战的深深担忧。人类对于自己开发的ChatGPT,不能接受伤到自己的巨大可能。人类需要停顿一下,给自己一点时间进行思考,找到有效对策。

ChatGPT底层的学习方式是“单字接龙”原理,即只允许用上文预测下一个字。ChatGPT把机器学习中的极端训练模式都用到了。直到ChatGPT3.5,先后经历了这三阶段,即无监督学习的“开卷有益”、有监督学习“模板规范”、强化学习的“创意引导”。通过这三个阶段的训练后得到“大语言模型”(Large Language Model,LLM),能够对海量互联网信息,文本、语音、图片进行学习,扩充模型的词汇量,语言表达,世界的信息与知识,最终形成“单字接龙”。

ChatGPT的核心模型结构,在2017年有了“开卷有益”;到2020年,又从“模板规范”到“创意引导”,技术模型的发展离不开从古至今,科研乃至各行业人员的成果信息之不断积累于互联网,将信息进行归纳总结和学习,得出回答。

ChatGPT能够将语言符号和指代对象关联起来,并与现实对应起来,这方面具有重大的里程碑意义。它让人类都看到了LLM的可行性、革命性。所以真正对人类社会带来冲击的,不是ChatGPT本身,而是它身后的改变社会发展方向的推动力。

自然语言处理(Natural Language Processing,NLP)技术也被誉为人工智能“皇冠上的明珠”。NLP是LLM的一种,它优势突出,可以不间断处理海量语言内容,处理速度快、效率高。ChatGPT的NLP是LLM中的佼佼者。LLM将变得更好用、更快速、更便宜。可以预测,相关产品也会如雨后春笋般普及。

大语言模型对社会的影响范围将和当初电脑的影响范围一样,即全社会。美国前国务卿基辛格认为这项技术的进步将带来新的认知革命,将重新定义人类知识,将加速我们现实结构的改变,并将重组政治和社会。

人类能通过群体协作创造知识、继承知识、运用知识。这三个环节,全都是依靠语言来实现。LLM的发明,允许人类将“海量”个体所获得的认识及载体统筹起来,在极短时间“掌握”过去与未来,能带来很多行业生产效率的大幅提升。

然而,ChatGPT也可能会威胁到全人类。ChatGPT操纵控制用户的能力会逐渐加强。欧洲警察组织警告说,像ChatGPT这样的LLM是危险的,因为它们使犯罪分子更容易采取行动。外媒还表示,ChatGPT可以用来了解大量了不解的潜在犯罪领域,从如何闯入住宅,到恐怖主义、网络犯罪和儿童性虐待方面均存在极大风险。欧洲刑警组织指出,ChatGPT可能被滥用来产生虚假的社交媒体,成为犯罪分子和大规模犯罪工具。美国哲学教授(Aumann)发现,学生提交的论文是由ChatGPT写的,因为论文的语法等各方面“过于”完美,而且论文是群体性的。

ChatGPT的“大语言模型”通过互联网掌握一个人几辈子都没法读完资料,会随意联想,有能力回答各种问题,但我们却很难指挥它,这是人类担心的关键所在。

霍金警告过,“人工智能(Artifical Intelligence,AI)将堪比第三次世界大战”。AI能控制接入全球互联网,能把世界上每一寸士地都通过卫星摄像头监控到,然后当他的算力足够强大的时候可以精确计算到每个人。GPT-5完成后,即将读取全人类的知识报道,训练视频数高达20亿GB,ChatGPT进化速度过快了。对一个算力发达,甚至可以想像到无限的当代,有网友假设了地球已经变成“乒乓球”,被“攥在”在恐怖分子的“手心”里。“恐怖分子利用AI,通过ChatGPT下达了一个消灭全人类的指令”。人类需要6个月的短暂时间思考,并找到切实有效的措施,防止ChatGPT被坏人利用。

“无意识但具备高智能的算法,可能很快比我们更了解自己。”霍金在《未来简史》中警告人类时如是说。“人工智能比核武器可怕”,马斯克也警告过人类。“公开信”中,马斯克也成为千人积极签名中的一员。

太阳下面没有新鲜事,历史总在重演。如何解决ChatGPT技术是一把双刃剑这个问题,可以回顾一下历史,从历史经验中找答案。

每项革命性的技术进步,都是各有利弊,人类应该有智慧处理ChatGPT这件事。正像人类发明“原子能技术”一样,核能能为人类提供电力,带来光明,核能也是原子弹的原理,人类也采取有效措施避免不应有的各种核灾难。

在ChatGPT技术上,笔者有如下建议:

一是要部署研究开发自己的“大语言模型LLM”来确保安全。ChatGPT将方便人类对技术知识的继承,也将带来网络安全和社会安全的新挑战,尤其要防范ChatGPT给国家安全带来的危险。在今年“两会”上,政协科技、科协联组会议上,朱松纯委员的发言是关于“信息领域的产业制高点问题”,引起了广泛共鸣。他谈了ChatGPT的发展和威胁,建议人工智能研究要提到“两弹一星”的高度,制定线路图,打通产学研用。要保证国家各机构数据安全,我国只能研发自己的NLP和LLM。

二是要做好从“应试教育”转向“能力培养”工作。ChatGPT的回答基本符合人类逻辑,一言一语都有因果关联,都是由前推后、由此及彼,所以它的回答有意义,也能解决我们提出的问题。未来的教育,应当注意培养批判性思维、逻辑能力。要培养孩子的批判性思维和逻辑能力。

三是跟上ChatGPT技术的发展潮流,学习能力培养愈显重要。现在我们仍要靠自己,靠学习能力,来应对后面加速变化的技术和工具。ChatGPT所掀起的浪潮已经不仅仅涉及个人,还关乎到各国未来。“应试教育”学生的考卷得分,无法与ChatGPT的得分相比,学生要做好终身学习的准备。教育机构要以提高学习能力、提高创造力为教育的主要目的,从小就训练学生适应快速变化的学习能力和创造能力。

四是如果学不会善用工具,终将被会用工具的人淘汰。没有人能阻止我们探索开发自己的NLP、LLM,要像电动汽车、AI一样,做到“人无我有,人有我优”,实现善用工具。能阻止我们的只有我们自己的心态和学习能力。人类有智慧的一大优势就在于善于利用工具。要先了解ChatGPT工具的优点和缺点,然后避开其缺点,使其优点为我所用。即使让ChatGPT从市场消失,取代现象也会随着其他新工具的出现而出现,不会因为人们的害怕和抵触而消退。

(作者系中国航天科技集团有限公司第十一研究院研究员)

版权声明:本文转载仅仅是出于传播信息的需要,并不意味着代表本网站观点或证实其内容的真实性;如其他媒体、网站或个人从本网站转载使用,须保留本网站注明的“来源”,并自负版权等法律责任;作者如果不希望被转载或者联系转载稿费等事宜,请与我们接洽。

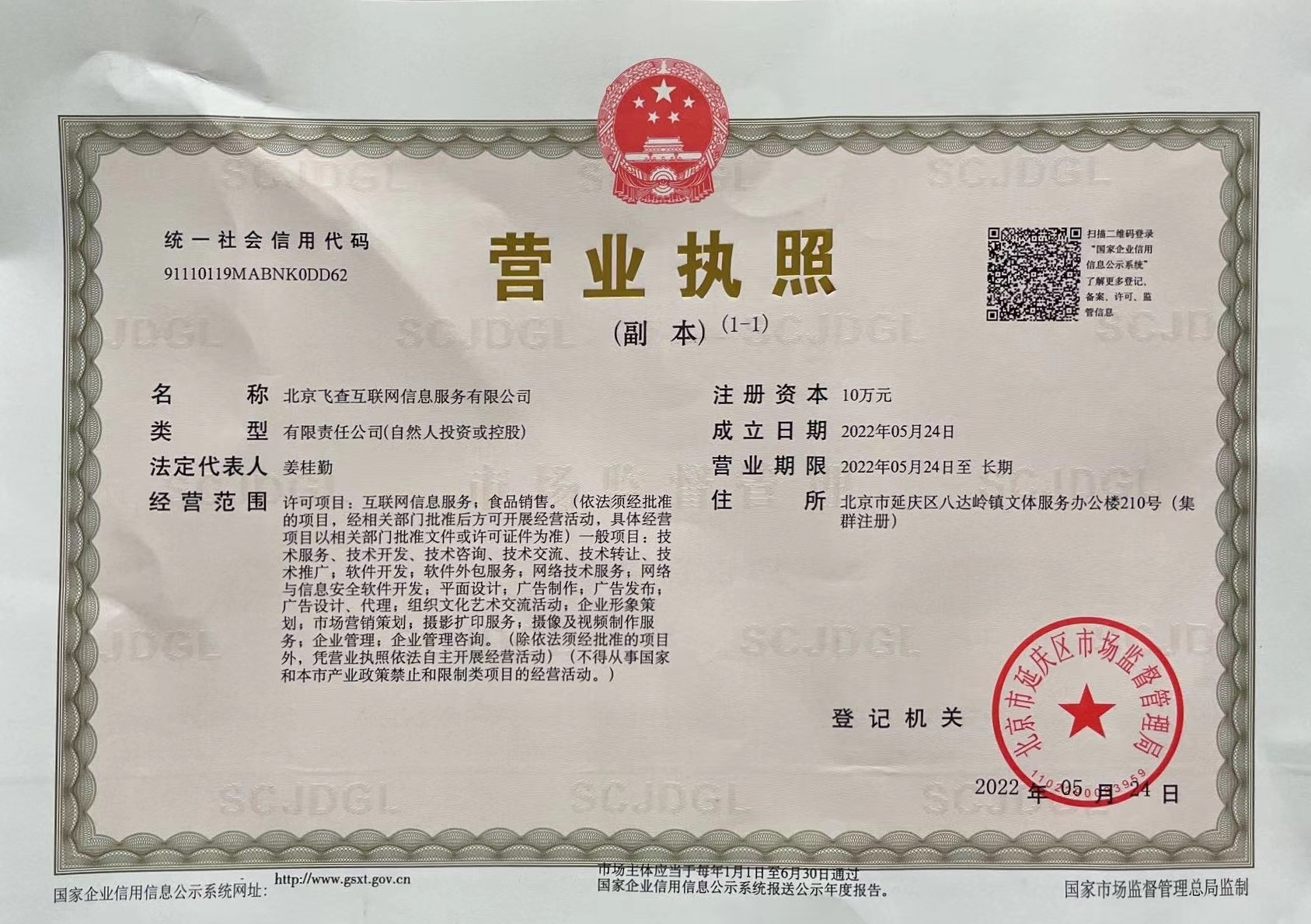

营业执照公示信息

营业执照公示信息