【资料图】

【资料图】

近日,广州一女子在地铁上的照片被AI一键脱衣,造谣说她在地铁上拍裸照,造谣图在网络广泛传播引发关注。事实上,照片的女主角是小红书的一名博主,而所谓的“裸照”则是她去年7月在平台分享的一张照片。原图中她衣着正常,完全没有任何不妥之处,但却被有心之人用AI软件一键脱衣,故意全网散播。她在得知此事后,立即向警方报案,并在小平台上发文澄清。(3月29日 极目新闻)

利用AI对他(她)人照片“一键脱衣”,恣意在网络空间传播,这分明是明目张胆地“造黄谣”,不仅突破了基本的做人底线与道德操守,也践踏到了法律的“红线”。

所谓“一键脱衣”,早在四五年前已经在网络出现了,刚开始的功能主要是简易“换脸”,以娱乐玩梗的方式进行传播,但是在应用过程中,逐渐被一些不法分子钻了漏洞,用于制造不雅照片和视频,在网络上传播和售卖,以此牟利或实施诈骗,不仅严重侵害公民的合法权益,也让科技成为造黄谣的“助力器”

现在的问题是,尽管虽然AI一键脱衣相关软件早已被封禁,但网络上并不难找出替代品,这显然意味着,AI“一键脱衣”,犹如脱缰的野马,仍在一直裸奔。数据显示,目前已经有数百万张被AI一键脱衣处理过的照片在网络上流传。尤其是,这些照片主涉及各个年龄段和职业领域的女性,包括明星、政治人物、教师、学生等。这些女性不仅面临着网络暴力和舆论压力,还可能遭受更严重的后果,如遭到勒索、威胁、诽谤、诋毁等。

在这个个人隐私信息,可以轻松被窃取、窥视和涂改的新科技时代,我们应该得到什么样的保护,如何找到破解之道?这是国家职能部门、互联网企业、包括每位公民都应该进行深刻思考与积极探究的。

实际上,对于AI“一键脱衣”等“深度合成”技术,并不缺少法律法规约束。《互联网信息服务深度合成管理规定》明确规定,不得利用深度合成服务从事侵犯他人合法权益等法律、行政法规禁止的活动;《网络安全法》也特别强调,明知他人实施危害网络安全活动的,不能够为他提供技术支持,如果情节严重,还会构成帮助信息网络犯罪活动罪等刑事犯罪。

显然,对于“一键脱衣”等灰色软件,职能部门仍需持续强化监管,激活现有法律,让平台守土有责,强化对侵权图片、视频的审核,加大打击灰色软件力度,将问题消灭于萌芽,让 AI科技不为造黄谣助力。

网络空间不是法外之地。除强化事前防范外,对造黄谣者乃至一切造谣者,依据《个人信息保护法》《刑法》等,让其付出沉重的法律代价,还当事人以清白和公道。

当然,作为每一名公民,也应成为信息安全的“守门员”,遇到不实、不雅等图片、视频信息时,要勇于举报,不去浏览低俗内容,这既是在保护他人和自己,也是在净化网络生态环境。

来源:红网吴睿鸫

版权声明:本文转载仅仅是出于传播信息的需要,并不意味着代表本网站观点或证实其内容的真实性;如其他媒体、网站或个人从本网站转载使用,须保留本网站注明的“来源”,并自负版权等法律责任;作者如果不希望被转载或者联系转载稿费等事宜,请与我们接洽。

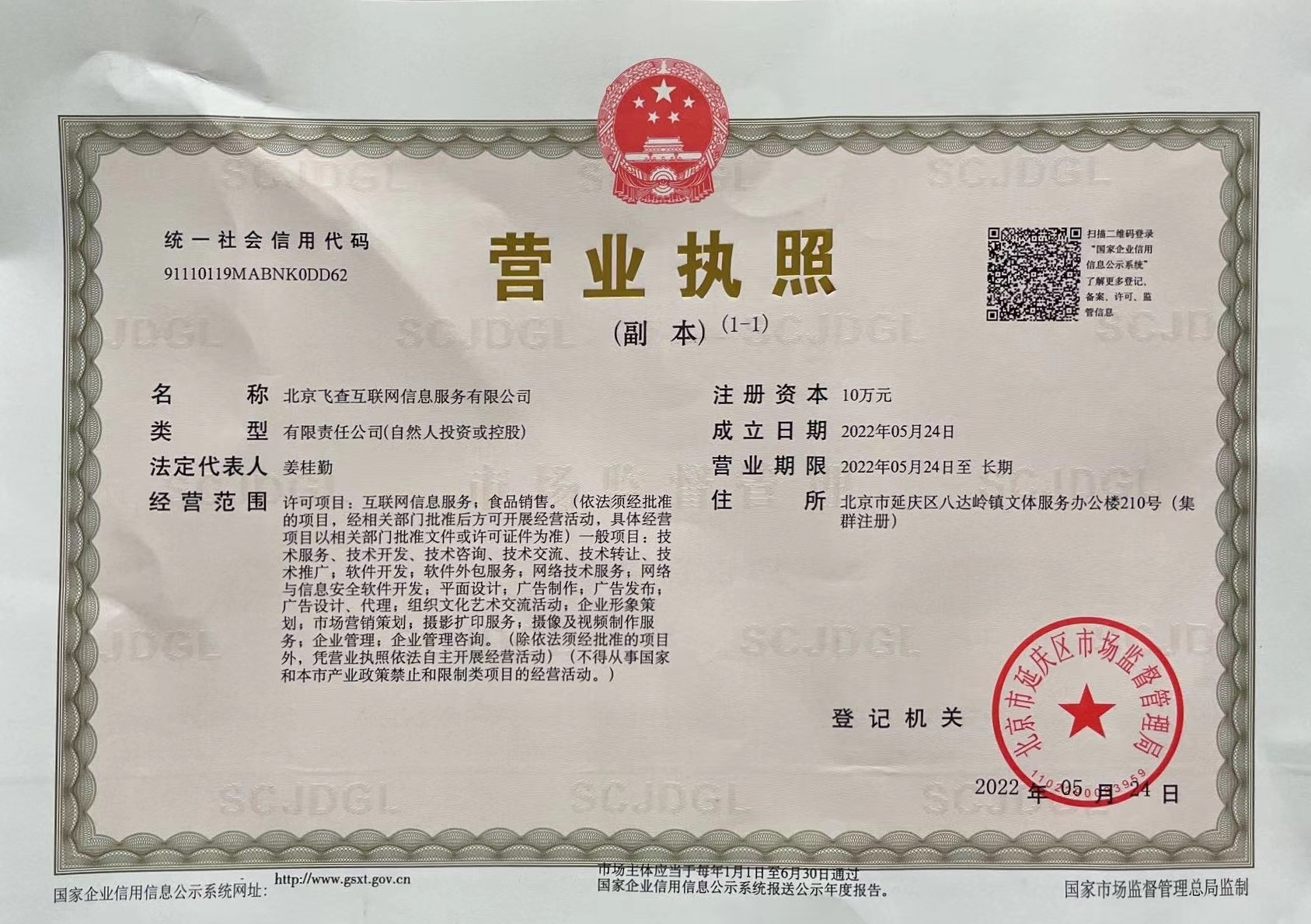

营业执照公示信息

营业执照公示信息